He estado confiando en las reseñas de Walter Writes AI para decidir qué herramientas de IA usar, pero últimamente las recomendaciones se sienten sesgadas y no muy detalladas. Estoy buscando sitios o recursos de reseñas de IA más confiables y exhaustivos que comparen funciones, precios y experiencias reales de usuarios. ¿Qué alternativas recomiendas y por qué confías en ellas?

Walter Writes AI: mi experiencia y cifras

Pasé un fin de semana trasteando con Walter Writes AI y los resultados fueron caóticos de una forma que no esperaba.

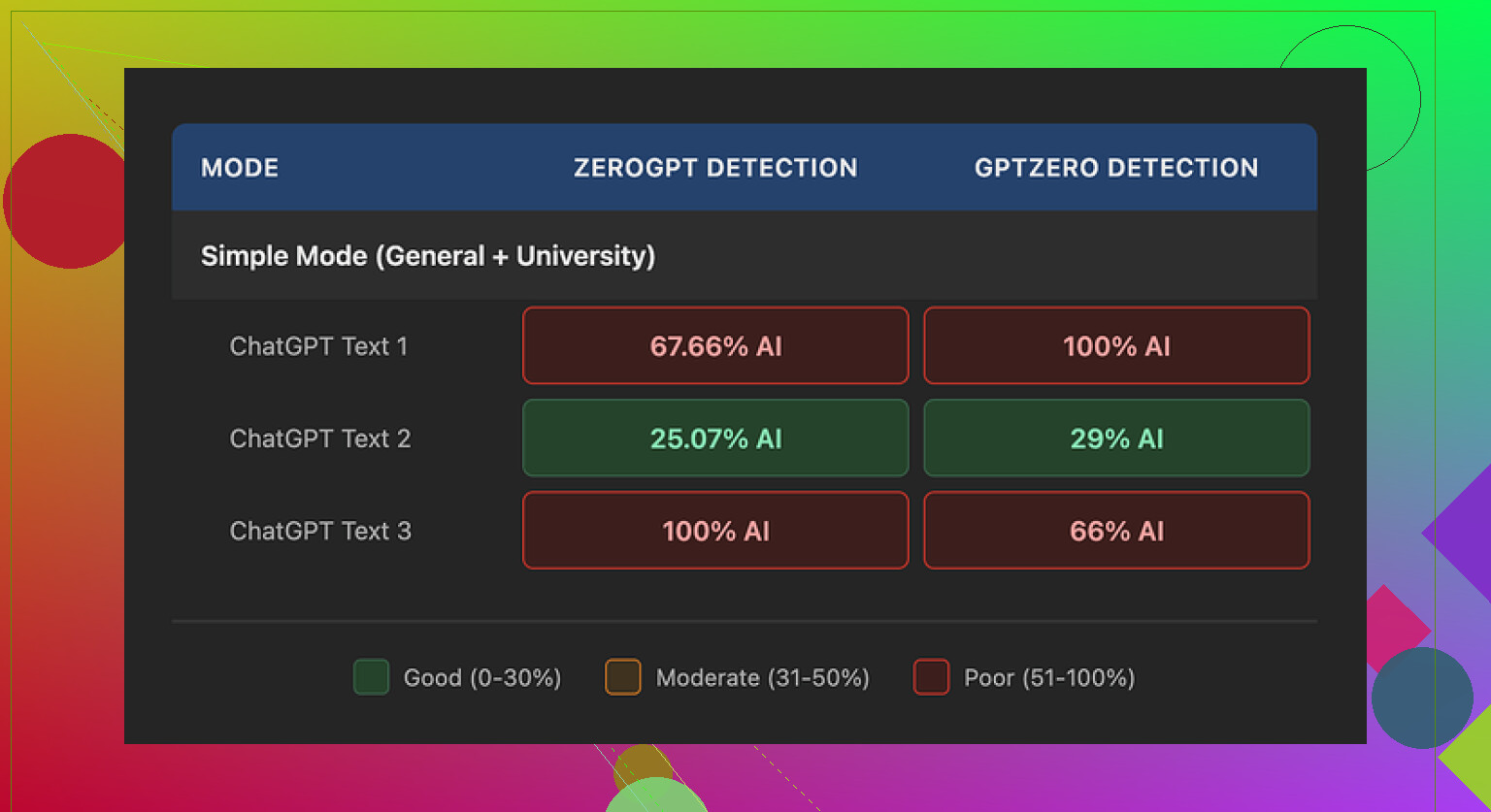

Metí tres muestras diferentes en la herramienta y luego pasé todas por GPTZero y ZeroGPT. Una de esas muestras volvió con puntuaciones que parecían decentes para una herramienta gratuita: 29% en GPTZero y 25% en ZeroGPT. Para que se entienda, la mayoría de sitios de “humanizador de IA” sin registro que probé en el pasado se quedan en el rango del 70–100% en al menos uno de los detectores.

Luego las otras dos muestras de Walter se fueron directas al 100% en al menos uno de los detectores. Bandera roja total, como si el texto no se hubiera tocado en absoluto.

Detalle importante: solo usé la versión gratuita. Eso te bloquea en el modo “Simple”. La página de precios afirma que los usuarios de pago obtienen los modos “Standard” y “Enhanced”, que se supone que tienen mejor comportamiento para saltarse detectores. No probé esos modos, así que no tengo datos de cómo puntúan.

Cómo era el resultado

El propio resultado se sentía raro de varias formas concretas:

• Iba metiendo puntos y coma donde esperarías comas. Se leía como si alguien hubiera ejecutado “reemplazar coma por punto y coma” como estilo de escritura.

• En una muestra se usó la palabra “hoy” cuatro veces en tres oraciones. Ese tipo de repetición es lo que dispara detectores y también molesta a lectores humanos.

• Abuso de paréntesis por todas partes. Cosas como “(p. ej., tormentas, sequías)” salpicadas por el texto, y esas mismas estructuras repetidas. El patrón parecía el típico relleno “académico” de la IA estándar.

Si tu objetivo es pegar esto en algo público, tendrías que editar el texto a mano. Mucho. Yo no me fiaría de usarlo sin editar para nada serio.

Precios y límites

Esto es lo que vi en sus precios:

• El plan Starter empieza en 8 dólares al mes si pagas anualmente, obtienes 30.000 palabras.

• El plan “Unlimited” está en 26 dólares al mes, pero cada envío se limita a 2.000 palabras. Así que en ese nivel estás limitado por entrada, no por mes.

• El nivel gratuito te da 300 palabras en total. No por día. En total. Me las ventilé en unas pocas pruebas.

Así que si escribes artículos largos, tienes que ir cortándolos en bloques de 2.000 palabras, lo que es molesto y además rompe el contexto.

Reembolsos y gestión de datos

Su página de reembolsos me llamó la atención por los motivos equivocados.

La redacción insistía mucho en las amenazas de contracargos, incluyendo menciones a acciones legales si vas a través de tu banco. La leí dos veces. Sonaba más a advertencia que a párrafo estándar de reembolsos de un SaaS.

En la parte de datos, no vi una línea clara y explícita que dijera cuánto tiempo guardan tu texto o cómo exactamente lo manejan después de enviarlo. Puede que se me pasara, pero parecía vago. Si trabajas con contenido sensible, yo tendría cuidado al copiarlo en herramientas con políticas de retención poco claras.

Qué me funcionó mejor

Después de obtener esas puntuaciones tan dispares con Walter, volví a algo que ya había usado:

Clever AI Humanizer

En los mismos detectores, su resultado tendía a puntuar más bajo en “probabilidad de IA” en mis pruebas, y el texto sonaba más cercano a cómo escribiría yo, o cualquier otro humano. No hay muro de pago para empezar, lo que hace que probarlo sea menos estresante.

Si quieres ejemplos paso a paso y pruebas de usuarios reales, esto me ayudó cuando estaba comparando herramientas:

Tutorial para humanizar IA en Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=es-es

Hilo de reseña de Clever AI Humanizer

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=es-es

Reseña en YouTube

Si estás probando Walter Writes AI, mi consejo sincero: toma las puntuaciones de los detectores como una primera comprobación y luego lee el texto en voz alta. Si se te traba la lengua con puntos y coma y palabras repetidas, probablemente a los detectores también.

Tuve el mismo problema con las reseñas de Walter Writes AI. Cortas, superficiales y todo parecía una pieza promocional.

Leí lo que compartió @mikeappsreviewer y coincido en la parte de la salida desordenada, pero creo que para ti el problema más grande está más arriba. Estás usando una sola fuente de reseñas para tomar decisiones sobre herramientas. Eso distorsiona todo.

Aquí tienes algunas alternativas que me ayudaron a obtener señales más honestas:

-

Sitios de reseñas independientes

• Futurepedia y There’s An AI For That

Buenos para descubrir herramientas. Flojos en profundidad. Úsalos para encontrar nombres, no para decidir.

• G2 y Capterra

Se centran en herramientas empresariales, pero las reseñas incluyen pros y contras, notas sobre precios y casos de uso. Lee primero las reseñas de 3 estrellas. Suelen ser las más equilibradas. -

Blogs de tecnología e IA que muestran pruebas

Busca reseñadores que:

• Compartan prompts y resultados en bruto

• Muestren capturas de pantalla

• Comparen herramientas con la misma tarea y el mismo input

• Admitan qué salió mal

Si una reseña no tiene ejemplos reales, la trato como contenido patrocinado. -

Reddit y comunidades de nicho

Subreddits como r/Artificial, r/ChatGPT, r/Entrepreneur y r/SEO suelen tener comentarios directos.

Busca “toolname review”, “toolname scam”, “toolname alternatives”.

Ordena por Top y This year para evitar información antigua. -

YouTube, pero con mucho filtro

La mayoría del contenido de IA en YouTube está lleno de afiliados.

Yo busco:

• Canales que muestren flujos de trabajo completos, no solo hype

• Pruebas largas sin cortes, no reels de 3 minutos de Top 10 herramientas de IA

• Comentarios que mencionen límites, errores o precios ocultos -

Para herramientas de humanización de IA y detectores específicamente

Como mencionaste herramientas, no solo reseñas, esto es lo que me ayudó:

• Elige uno o dos detectores de IA públicos que te importen, como GPTZero o ZeroGPT.

• Haz tus propias pruebas A/B con muestras pequeñas.

• Compara herramientas con el mismo texto, no con entradas distintas.En ese espacio, Clever AI Humanizer me ha funcionado mejor que el resultado de Walter. Menos puntuación rara, menos frases repetidas y un flujo más natural. Sigo editando todo a mano, pero requiere menos limpieza. Si dependes de SEO o de escritura de estilo académico, esa combinación de herramienta más revisión humana es más segura.

-

Cómo confiar en una fuente de reseñas

Uso una lista sencilla:

• Indican si tienen afiliados o patrocinios

• Muestran ejemplos reales, no capturas de stock

• Enumeran aspectos negativos y quién debería evitar la herramienta

• Comparan contra una base como ChatGPT o Claude

• Actualizan las publicaciones cuando cambian los precios o las funciones

Si un sitio se parece a Walter Writes AI, textos breves, muchos enlaces de afiliado, sin proceso de prueba real, lo uso solo como directorio y luego contrasto en otros lugares.

Movimiento práctico para ti ahora mismo:

• Elige 3 herramientas que estés considerando a partir de Walter.

• Busca cada una con “toolname review reddit” y “toolname vs competitor”.

• Pasa por ellas un pequeño proyecto de prueba.

Obtendrás más información útil con dos horas de tus propias pruebas más reseñas variadas que con doce listas de Top 10 herramientas de IA.

Mismo caso aquí. Usé durante un tiempo las reseñas de Walter Writes AI como una lista rápida, y de repente me di cuenta de que básicamente estaba leyendo el mismo párrafo de “esta herramienta es increíble” 50 veces con distintos logos.

Creo que @mikeappsreviewer y @waldgeist tienen mucha razón en no apoyarse en una sola fuente y en revisar resultados reales, pero yo ajustaría un poco el enfoque.

Lo que me funcionó mejor:

-

Usar Walter solo como directorio, no como herramienta de decisión

Trátalo como una guía telefónica: útil para descubrir nombres, inútil para averiguar qué es realmente bueno. El sesgo que notas seguramente viene de afiliados, y una vez que te das cuenta de eso ya no puedes “desverlo”. -

Pasarte a sitios que documenten un protocolo de pruebas

Dejo de leer si una reseña no me dice cómo probaron. Busco cosas como:

• “Usamos el mismo prompt en las herramientas A, B, C”

• “Aquí tienes capturas de pantalla de los resultados”

• “Este es el prompt completo que usamos”

Sin eso, es texto de marketing, no una reseña.

Algunas categorías a revisar:

• Blogs de dev / datos que comparan modelos o herramientas en tareas específicas

• Blogs de productividad que muestran flujos de trabajo completos (escritura, código, investigación)

• Comparaciones de estilo académico para LLMs y detectores si te importa el rigor -

Usar la documentación y el roadmap del proveedor como prueba de cordura

Suena aburrido, pero comparar lo que dicen la documentación y el changelog de una herramienta con lo que afirman las reseñas es sorprendentemente útil. Si las reseñas dicen “perfecto para colaboración en equipo” y el producto no tiene funciones reales de equipo en la documentación, ahí tienes tu bandera roja. Las reseñas tipo Walter suelen exagerar mucho en esto. -

Convertir tu propio caso de uso en un mini benchmark

En lugar de un genérico “¿esta herramienta es buena?”, define:

• 1 o 2 tareas reales que hagas mucho (cold emails, descripciones de producto, refactorización de código, planes de clase, lo que sea)

• 1 métrica que te importe (tiempo ahorrado, tiempo de edición, puntuación en el detector o tasa de respuesta de usuarios)

Luego:

• Ejecuta esas mismas tareas en 2–3 herramientas que descubriste mediante Walter u otras fuentes

• Cronométrate y anota cuánto trabajo de limpieza necesita cada una

Eso supera leer 10 listas superficiales. Las reseñas pueden decirte qué probar, pero no van a saber cuán exigente es tu jefe, profesor o tus clientes. -

Sobre herramientas de “humanizar” / detectores de IA específicamente

Como Walter también impulsa herramientas en ese espacio, yo sería aún más cauteloso. Mucho bombo, muy poca honestidad. En mi caso:

• Solo me importa cómo se comporta el texto frente a los detectores que realmente cuentan en mi contexto (para algunos será GPTZero, para otros PlagScan, Turnitin, etc.)

• Mantengo una pequeña biblioteca de párrafos de muestra (formal, informal, técnico) y los reutilizo en cada herramienta que pruebo

• Hago una lectura en voz alta para detectar puntuación rara y repeticiones, porque esas cosas aún hacen saltar a los detectores y también a los humanosEn ese contexto, Clever AI Humanizer me ha funcionado razonablemente bien. Menos puntuación rara que lo que la gente describe con la herramienta de Walter, y el texto se parece más a algo que yo escribiría después de un café, no a un robot abusando de los puntos y coma. No es magia, todavía hay que editar, pero como capa base ha sido lo bastante útil como para seguir en mi stack.

-

Tampoco confíes del todo en Reddit / YouTube

Discrepo un poco en apoyarse mucho en ellos, aunque @waldgeist dio buenos argumentos:

• Reddit puede volverse súper negativo o súper hype por un solo comentario viral

• YouTube está inundado de “Top 20 herramientas de IA” con afiliados que son básicamente anuncios

Sigo usando ambos, pero:

• En Reddit, ordeno por “Top” y literalmente reviso el historial de comentarios del usuario para ver si promociona el mismo producto en todos lados

• En YouTube, solo confío en creadores que muestran flujos de trabajo completos, sin cortes, y que mencionan lo que no funcionó -

Construir una pequeña “lista de confianza” de reseñadores

Con el tiempo identificas 2–3 autores / canales / blogs cuyas opiniones se alinean con tus propias experiencias. Los guardo en marcadores y doy mucho más peso a lo que dicen que a directorios generales como Walter. Si ellos dicen “esto es mediocre” y Walter dice “10/10, revolucionario”, sé a quién creerle.

Si quieres un cambio práctico rápido ahora mismo:

• Sigue usando Walter solo para recopilar nombres de herramientas.

• Contrasta esas herramientas con 1–2 reseñadores que muestren su proceso de pruebas.

• Para escritura / humanización, añade Clever AI Humanizer a la mezcla y haz tu propio A/B con el mismo texto y tu detector objetivo.

Una vez que hagas eso una o dos veces, vas a confiar más en tus propios mini benchmarks que en cualquier sitio de reseñas al estilo Walter, esté sesgado o no.

El sitio de Walter es básicamente una cuadrícula de afiliados, así que a estas alturas lo trataría como ruido de fondo. Los demás ya dejaron claro lo de “usa múltiples fuentes”, así que aquí van algunos enfoques en los que no insistieron tanto:

1. Evalúa las herramientas como evaluarías una librería de desarrollo

En lugar de “¿esta herramienta es buena?”, pregúntate:

- ¿Tiene un changelog público y ejemplos reales?

- ¿Publican límites (tamaño de contexto, topes de uso, tipos de detectores si es un humanizador)?

- ¿Hay una hoja de ruta pública o al menos un patrón de actualizaciones significativas durante 3–6 meses?

Si una herramienta no muestra historial y los únicos elogios vienen de listas al estilo Walter, paso totalmente de largo.

2. Crea un pequeño “paquete de benchmarks” interno

Todos dijeron “haz tus propias pruebas”, pero puedes formalizar eso en algo repetible:

-

Crea 4–5 fragmentos canónicos para tu caso de uso:

- 1 párrafo informal

- 1 párrafo de estilo formal / académico

- 1 párrafo sobre un tema técnico / de nicho

- 1 bloque de texto largo (800–1200 palabras)

-

Para cada herramienta nueva, siempre:

- Le pasas esos mismos fragmentos

- Anotas: tiempo de edición, rarezas (repeticiones, puntuación) y cualquier puntuación de detectores que te importe

- Guardas las salidas en una carpeta local para poder comparar en paralelo después

Haces esto una vez y de repente las “reseñas” se vuelven casi opcionales. Tu benchmark se convierte en tu principal fuente de evaluación.

3. Trata a los reseñadores como modelos que estás afinando

Ya tienes a @waldgeist, @viajantedoceu y @mikeappsreviewer dando aportes muy sólidos. En lugar de solo sumar más voces, elige un pequeño grupo de reseñadores y compara de verdad sus afirmaciones con tus propias pruebas:

- Cuando recomienden una herramienta, pásala por tu paquete de benchmarks.

- Anota quién tiende a sobrevalorar o a minimizar las debilidades.

- Con el tiempo terminas con un “peso” mental para cada reseñador.

Esto es más útil que confiar ciegamente en Reddit o YouTube. Estás calibrando personas, no solo herramientas.

4. Sobre herramientas “AI humanizer” como Clever AI Humanizer frente a lo de Walter

Mencionaste detectores, así que es relevante comparar herramientas en ese nicho. Por mi experiencia y en línea con lo que ya se comentó:

Ventajas de Clever AI Humanizer

- Ritmo de frases generalmente más natural que lo que describiste de Walter (menos abuso aleatorio de punto y coma).

- Maneja mejor la repetición, así que es menos probable ver patrones tipo “hoy… hoy… hoy”.

- Bastante bueno preservando el significado en lugar de destrozar párrafos solo para bajar puntuaciones de IA.

- El modelo de prueba gratuita hace más seguro incluirlo en tu paquete de benchmarks sin comprometerte.

Desventajas de Clever AI Humanizer

- No es magia: la salida en bruto sigue siendo “con sabor a IA” en partes y necesita sí o sí una revisión humana si hay mucho en juego (académico, legal, SEO delicado).

- Algunos resultados suenan demasiado pulidos o estandarizados, lo que puede ser sospechoso en contextos muy informales.

- Si los detectores evolucionan, tendrás que repetir tus benchmarks; no es una solución permanente.

- A veces suaviza demasiado la redacción técnica, así que puede que debas reinyectar vocabulario específico del dominio.

No coincido del todo con apoyarse tanto en un solo “humanizer”. Toma Clever AI Humanizer como un asistente para el borrador, no como un manto de invisibilidad. Tu paquete de benchmarks y tu propia revisión importan más que la marca que elijas.

5. Cómo reemplazaría a Walter en tu flujo de trabajo ahora mismo

Cambio concreto que evita repetir listas de pasos anteriores:

- Usa Walter solo como fuente de nombres. Nada más.

- Para cada herramienta prometedora, haz solo tres cosas:

- Revisa por encima la documentación y el changelog del producto para ver si las funciones anunciadas coinciden con la realidad.

- Pásala por tu paquete de benchmarks y registra tiempo de edición y resultados en detectores.

- Contrasta con uno o dos reseñadores que ya tengas “calibrados” (incluyendo gente como los tres que ya están en este hilo).

Tras dos o tres rondas de esto, te darás cuenta de que el sitio de Walter es básicamente un directorio, no un motor de decisiones, y que tus micro-benchmarks más algo como Clever AI Humanizer para pulir te dan señales mucho más fiables que cualquier hub de reseñas individual.